李宏毅機器學習筆記 | L9 | 訓練深度神經網路DNN的技巧

本篇內容整理了深度神經網絡(DNN)的訓練技巧,包括對抗過擬合的方法、新激活函數的選擇、自適應學習率及使用Dropout等正則化技術。

· 641 words · 3 min read · 35

本篇內容整理了深度神經網絡(DNN)的訓練技巧,包括對抗過擬合的方法、新激活函數的選擇、自適應學習率及使用Dropout等正則化技術。

本文深入探討了反向傳播演算法背後的運作機制,解釋如何利用鏈式法則和梯度下降來有效地優化神經網絡模型。

探索深度學習的歷史起源,從感知器到當代的多層神經網路,並了解Deep Learning如何影響影像辨識與語音辨識。

這篇文章詳細介紹了Logistic Regression的數學基礎、訓練方法和應用,並比較了Discriminative與Generative模型。

探索梯度下降、學習率適應、Stochastic Gradient Descent以及分類模型的詳細機制,並掌握如何優化機率生成模型以提高分類準確性。

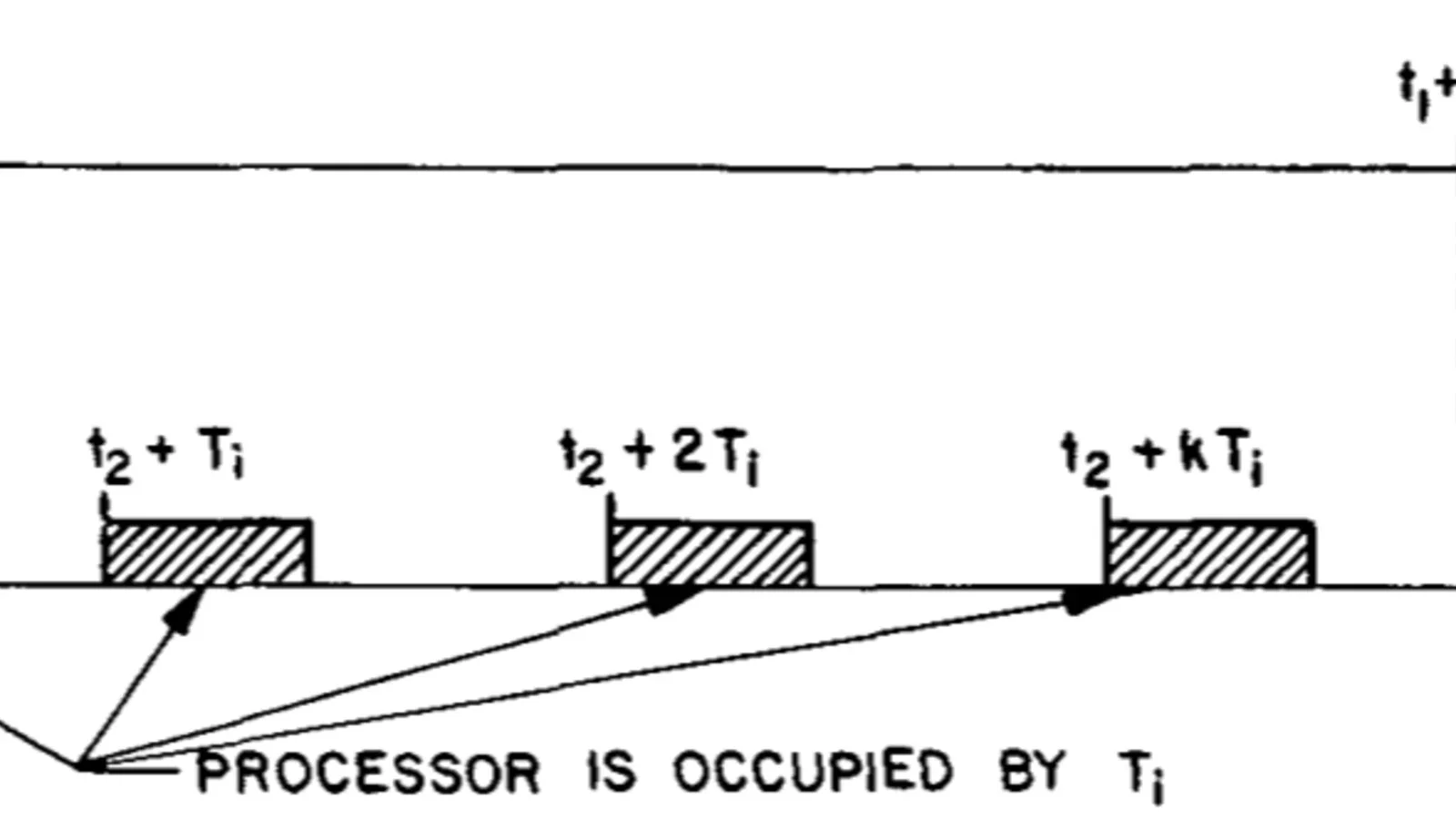

#Scheduling Algorithms for Multiprogramming in a Hard-Real-Time Environment Author C. L. Liu, Project MAC, Massachusetts Institute of Technology Hames W. Layland, Jet Propulsion Laboratory,…